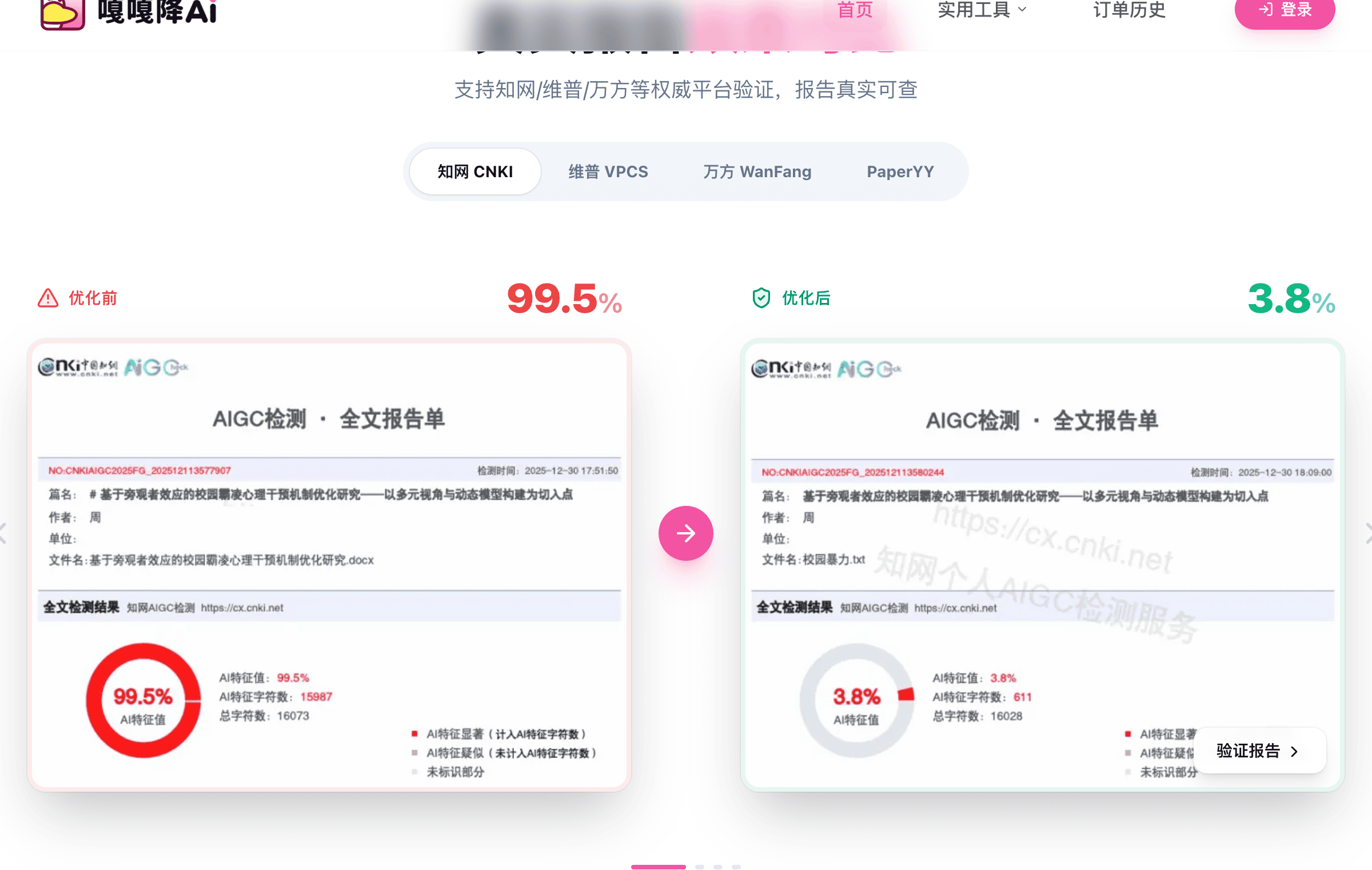

2025年12月底,知网AIGC检测系统做了一次重大升级。

很多同学发现,以前用着挺好的降AI工具突然不好使了,原来能降到15%的,现在降到40%就降不下去了。

原因在于知网改变了检测逻辑,而大多数工具没有跟上。嘎嘎降AI却能稳定过检,这背后有一个值得说清楚的原因。

知网这次升级改变了什么

知网2025年12月28日的升级,核心变化是:从"文本重合度检测"转向"语义逻辑连贯性检测"。

以前的检测逻辑偏向查重:看你的文本有没有和已发表的文章重复,侧重词汇和短语层面的比对。

新的检测逻辑更复杂:它看的是你的写作"像不像AI在写"——

- 句式是不是太工整,有没有规律性的长短句模式

- 用词是不是太"标准化",缺少个人偏好词

- 段落之间的逻辑过渡是不是太顺滑,没有人类写作那种"跳跃感"

- 信息密度是不是太均匀,每段信息量差不多

简单说,新版检测系统学会了"识别AI写作的感觉",而不只是"找重复的词"。

为什么旧方法失效了

知网升级之前,很多降AI方法还能用:

同义词替换:换词之后,重合度降低了,2024年版的检测系统可能会放行。但2026年的检测看的是语义模式,换了词,写作特征没变,新系统照样能识别。

简单改写:改了几个句子,大部分还是AI写的,整体写作模式没有变化。新系统有足够的鲁棒性识别局部改写。

让AI改AI:依然是AI的统计特征,新系统没有改变过AI文本的本质。

这解释了为什么升级后很多人发现工具突然"不好用了"——工具本身没变,但检测系统的规则变了,原来够用的处理程度现在不够了。

嘎嘎降AI为什么能稳定过检

嘎嘎降AI(www.aigcleaner.com)的双引擎技术,针对的是AI写作的底层统计特征,而不是某个特定版本的检测规则。

语义同位素分析引擎:识别文本中的AI特征——哪些部分词汇太均匀、句式太对称、逻辑太顺滑。这是在"检测的逻辑"层面工作,而不是针对某个平台的规则。

风格迁移网络引擎:把识别出来的AI特征,在语义层面重构为"人类写作的表达方式"——引入词汇分布的随机性、打破句式的对称性、制造段落间的"自然停顿感"。

这个逻辑和知网升级后的检测逻辑是"对称"的:知网升级后看的是语义级的AI特征,嘎嘎降AI处理的也是语义级的AI特征。只要检测系统的目标是"识别AI写作风格",双引擎技术就有效。

实测数据:知网升级后,嘎嘎降AI处理的文本依然维持:知网62.7%→5.8%,维普67.22%→9.57%,多平台稳定。

一个实用判断标准

如何判断一个降AI工具能不能适应2026年新版检测?

看原理,不看宣传:如果工具的核心是同义词替换或句式调整,基本上在2026年效果大打折扣。如果工具做的是语义层面的重构(无论它怎么命名),适应性更好。

用新版检测测试:拿一篇高AI率的文章,用工具处理后在知网检测。降幅达到70%以上的工具(比如90%→27%),说明有一定的语义重构能力。

看多平台表现:多平台都能稳定降AI的工具,说明它改的不是针对特定平台的规则,而是通用的AI写作特征。

嘎嘎降AI支持9大平台验证,承诺AIGC率降至20%以下,不达标可退款,这个承诺背后是对自身技术的信心。

| 检测维度(2026年新版) | 同义词替换工具 | 嘎嘎降AI双引擎 |

|---|---|---|

| 词汇分布均匀性 | 有改善 | 有效处理 |

| 句式对称性 | 几乎无改善 | 有效处理 |

| 逻辑过渡顺滑度 | 无改善 | 有效处理 |

| 信息密度均匀性 | 无改善 | 有效处理 |

| 综合效果 | 降幅20-30% | 降幅80-95% |

如何应对2026年的新版检测

方向一:用做语义重构的工具。嘎嘎降AI(www.aigcleaner.com)、比话降AI(www.bihuapass.com)、率零(www.0ailv.com)都属于语义层面的改写工具,适应新版检测。

方向二:从写作源头降低AI率。写初稿时让DeepSeek用口语化风格、长短句不一的方式输出,能从源头降低20-30%的AI率,后期处理压力小很多。

方向三:人工精修高AI率段落。文献综述、问题分析这些"标准段落"AI率最高,在工具处理之外,针对性地人工重写这些部分,能进一步降低AI率。

知网升级后,之前已经降好的论文还需要重新处理吗?

如果论文已经通过了检测,不需要重新处理。检测是基于当时的算法版本,通过了就算过了。如果你的论文还没提交,建议用当前版本的工具重新跑一遍,确认在最新算法下依然达标。

算法还会继续升级吗?

会。检测和降AI是一个持续对抗的过程。建议用有持续维护能力的工具,提交前用最新版本测试,而不是相信"之前测过没问题"。

工具推荐:

- 嘎嘎降AI:www.aigcleaner.com(9大平台验证,不达标退款)

- 比话降AI:www.bihuapass.com(知网专精)

- 率零:www.0ailv.com(深度语义重构)