换了几款降AI工具,试了同义词替换、调语序、AI改AI……AI率从67%降到了55%。还差得远。

这不是工具问题,是方向问题。大多数降AI工具效果差的原因,其实可以用三个字解释清楚:「换皮了」。

AIGC检测究竟在看什么?

在说工具之前,先理解检测系统在做什么。

知网AIGC检测算法看的是两个核心指标:

困惑度(Perplexity):衡量文本的「可预测性」。AI生成的文字非常顺滑——每个词都很好地预测了下一个词。这种顺滑感对应低困惑度,是AI写作的典型特征。人类写作中有更多意外、跳跃、口语化的表达,困惑度更高。

突发性(Burstiness):衡量文字节奏的变化程度。AI生成的句子长度非常均匀,逻辑推进很线性;人类写文字有时候短句收尾,有时候铺陈长段,节奏起伏。这种「不均匀感」叫突发性。

简单说:检测算法在找「过于顺滑、过于均匀」的文字,这就是AI写作的指纹。

为什么这3种方法效果差?

问题1:同义词替换——换了词没换模式

把「研究」换成「探究」,把「因此」换成「所以」,是最常见的操作。

这种方法有一个根本问题:你改了词,但句式结构、语义节奏一点没变。

有个实测案例:把「人工智能技术在医疗领域的应用日益广泛」改成「AI科技于医学范畴之运用愈发普遍」。用词完全不同,但句子的信息密度、逻辑结构、语义节奏完全一致,知网AI率只从75%降到72%——基本没变。

算法识别的是「这个句子的组织方式像AI」,而不是「这个句子里用了哪几个词」。换词对困惑度和突发性都没有实质影响。

另一个实测数据:用纯同义词替换工具处理一篇论文,AI率从67%降到55%,还是远超30%的线。

问题2:AI改AI——越改越像

用DeepSeek或ChatGPT「重写」一段AI生成的内容,AI率不降反升——这不是概率问题,这是必然的。

原因在于:大语言模型在改写时的目标是「让句子更流畅、更连贯」。而「流畅连贯」正好对应「低困惑度」——正好是检测算法要标记的特征。

你让AI改得越好,句子越「顺」,检测分数就越高。这是方向性错误,怎么改都不行。

问题3:语序调整——语义指纹没变

「把A句和B句调换顺序」或者「把一个长句拆成两个短句」,这类操作改变了句子表面,但语义逻辑没有变。

检测算法比你想象的聪明——它分析的不是单个句子,而是段落内的语义连贯性和逻辑链条。你调换顺序,段落的整体语义结构基本不变,困惑度和突发性的变化也微乎其微。

嘎嘎降AI的双引擎如何解决这个问题

嘎嘎降AI(www.aigcleaner.com)用的是「双引擎驱动」方案:

语义同位素分析:先理解这段话的核心含义是什么,把语义内容提取出来,类似于提取「有效成分」而不是「文字外壳」。

风格迁移网络:把提取出来的语义内容,用一种更具「突发性」的方式重新组织——加入句式变化,打破均匀节奏,让困惑度提升到接近人类写作的水平。

这个过程不是「换词」,而是「用另一种结构表达同样的意思」。结果是困惑度和突发性都发生了实质变化,而不只是词汇层面的扰动。

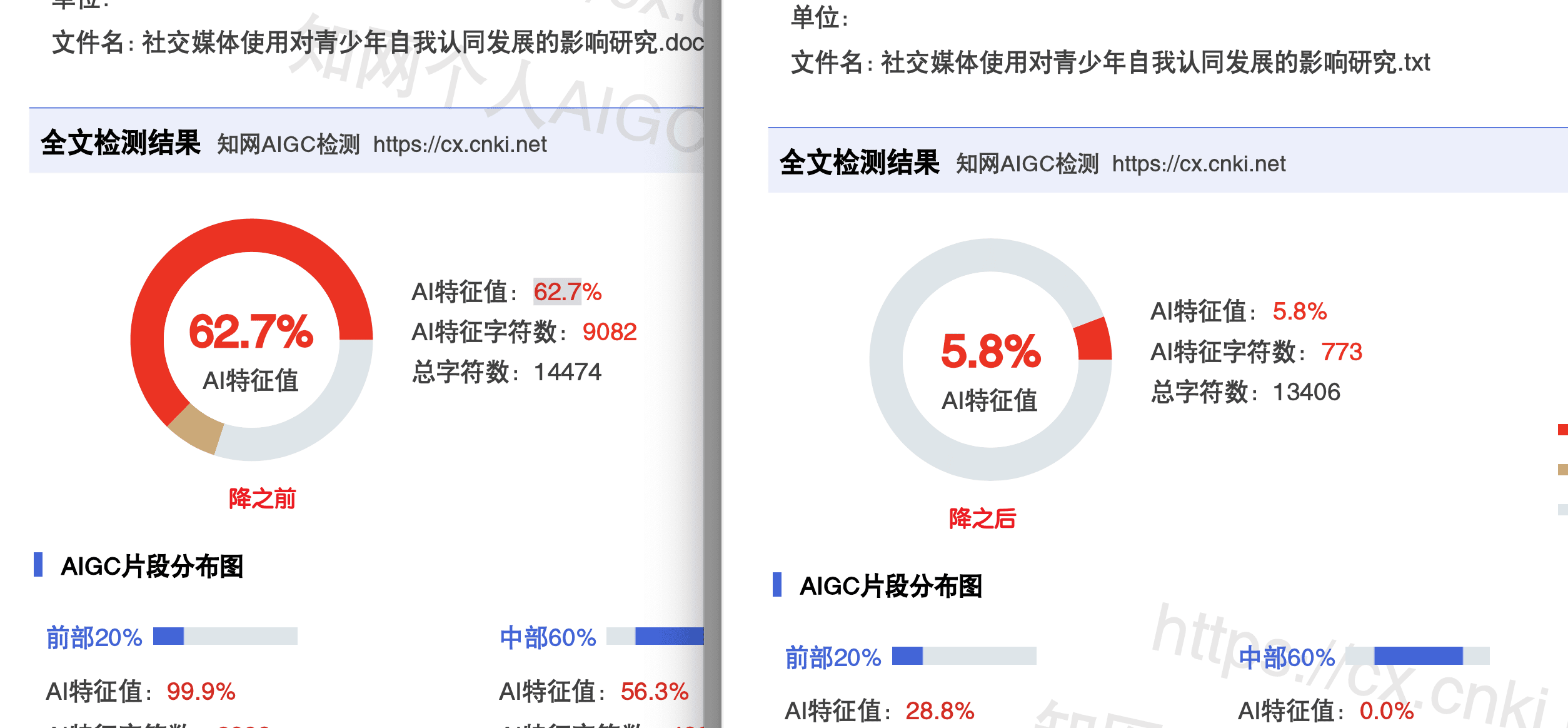

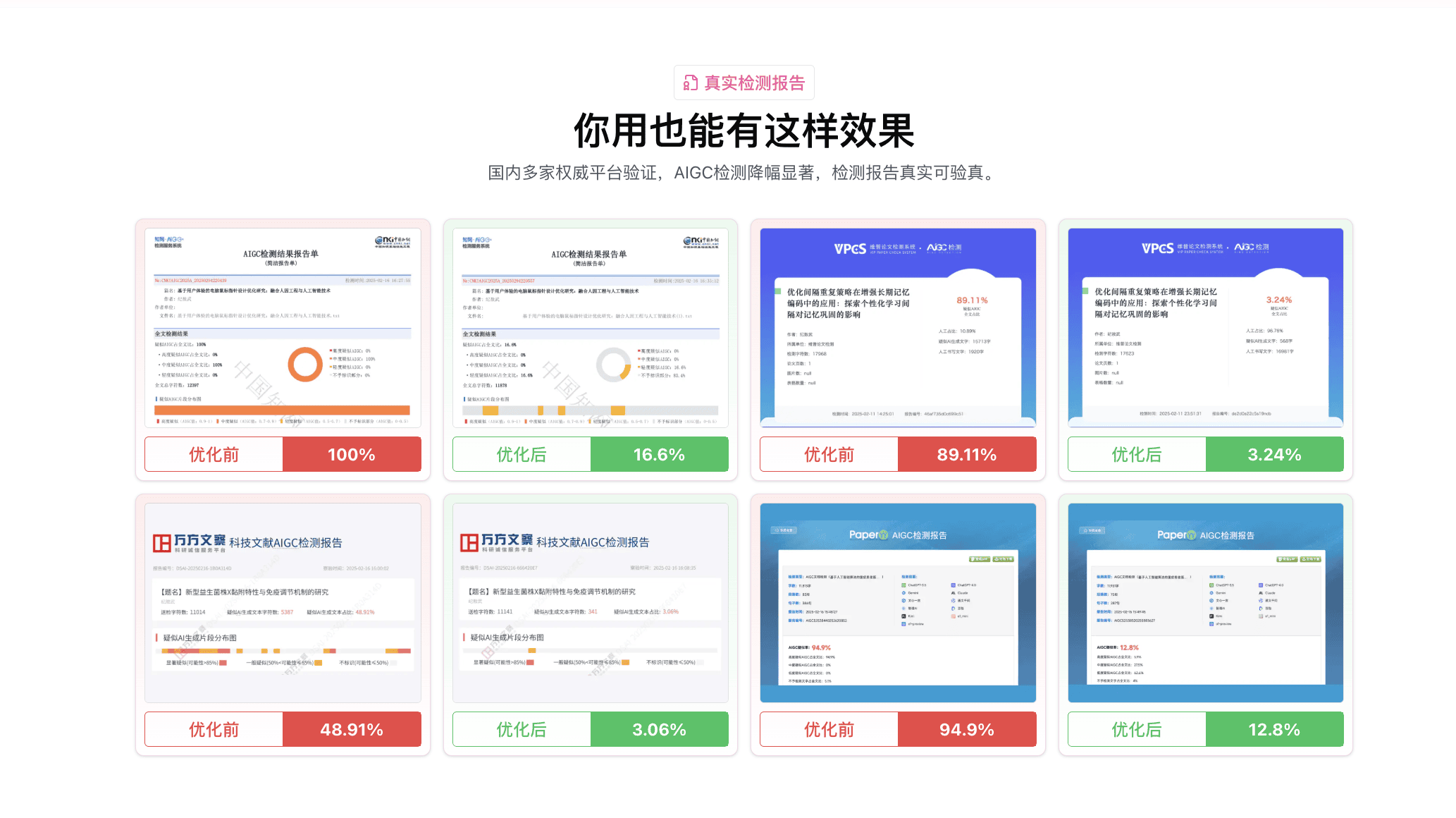

实测对比:同义词替换工具处理,AI率从67%降到55%(不达标);嘎嘎降AI处理同一段落,降到5.8%(达标,一次通过)。

从62.7%降到5.8%——这不是调参数调出来的,是底层技术路线不同的结果。

所有工具的本质区别就一条

选降AI工具,核心问题只有一个:它在处理哪个层面?

| 技术路线 | 处理层面 | 对困惑度/突发性的影响 | 实际效果 |

|---|---|---|---|

| 同义词替换 | 词汇层面 | 基本没有 | AI率降5-15% |

| 语序调整 | 句子表面 | 极小 | AI率降10%以内 |

| AI改AI | 词汇+表面 | 负面(更低困惑度) | AI率可能更高 |

| 语义重构(嘎嘎降AI双引擎) | 语义+结构层面 | 显著提升 | AI率降50-60%+ |

比话降AI(www.bihuapass.com)的Pallas引擎同样在语义层面处理,知网AI率目标<15%,适合知网专项场景。

所以,效果差的工具能不能用?

不是完全不能用,是要搞清楚什么时候用。

如果你的论文AI率在20%-30%之间,换词工具可以帮你降个5%-10%,勉强能过线。但如果你是50%以上,换词工具是浪费时间和钱——只有从语义层面重构的工具才能真正把高AI率降下来。

效果差不是工具的「道德问题」,是技术路线的问题。对症下药,才能不花冤枉钱。